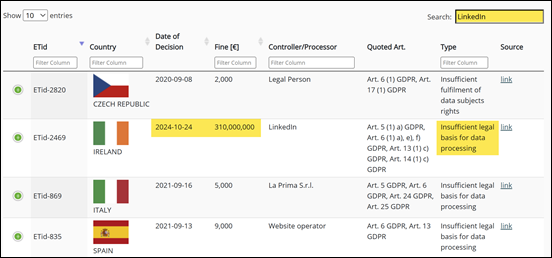

In haar wederhoor op het Telegraaf artikel van Rosanne de Jong zegt LinkedIn het volgende:

In haar wederhoor op het Telegraaf artikel van Rosanne de Jong zegt LinkedIn het volgende:

‘Personal data from a customer’s Applicant Tracking System (ATS) is not shared with other LinkedIn customers or used by LinkedIn to train AI. Data in an ATS is used to enable the delivery of features for the customer in LinkedIn Recruiter, and our contracts with customers limit our use of this data. When a customer chooses to sync data to LinkedIn, we are able to show the customer information provided from their ATS within LinkedIn Recruiter so that customers have up-to-date information about each candidate in one place without needing to continuously switch between Recruiter and ATS platforms. Data is processed with security measures in place, in compliance with customers’ instructions, and can be deleted on request received from customers. When it comes to GDPR compliance for ATS integrations, our customers are the data controllers and LinkedIn is the data processor.’

Kort gezegd: LinkedIn is brandschoon. Laat ik eens een poging wagen om LinkedIn’s reactie van enige context te voorzien: