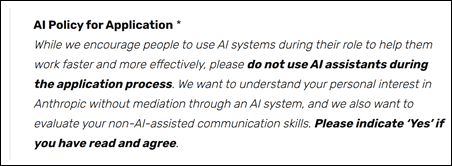

Een slordige 5 maanden geleden schreef ik over Anthropic’s oekaze richting sollicitanten. Onderstaande tekst was onderdeel van het sollicitatieformulier:

Met andere woorden, gebruik Claude (en alle andere LLM-(ondersteunde cv-)tools) voor alles, behalve om bij Anthropic (de bouwer van Claude) te solliciteren. Afgezien van het feit dat Anthropic hiermee zichzelf volstrekt belachelijk maakte, is het ook nog eens uiterst eenzijdig. Tenslotte staat hier niets vermeld over de werkwijze van de recruiter. Wordt in deze rol het gebruik van Claude (en alle andere LLM-(ondersteunde cv-tools) ook verboden? Daar zegt Anthropic niets over, maar dat lijkt me wel het minste wat ze kunnen doen gezien het “verzoek” aan sollicitanten. Voor de goede orde, sollicitanten moesten hiermee akkoord gaan om een sollicitatie te kunnen versturen.

Eind mei leek Anthropic zich bewust te zijn van haar gaffe. Anthropic CPO Mike Krieger zei hierover het volgende:

“We’re having to evolve, even as the company at the forefront of a lot of this technology, around how we evaluate candidates. So our future interview loops will have much more of this ability to co-use AI.”

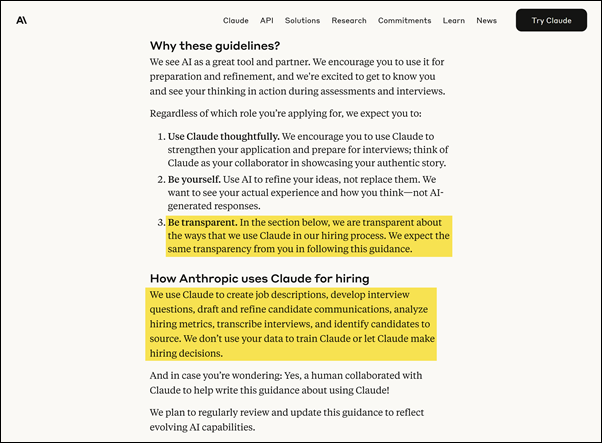

En nu is er dan (sinds 10 juli) een AI guidance van Anthropic. Waarmee het bedrijf willens en wetens sollicitanten verplicht om Claude te gebruiken voor die onderdelen van het sollicitatieproces waarbij AI-ondersteuning wordt toegestaan. Dat is opvallend en bijzonder dom. Maar dit terzijde. Laten we deze guidance eens nader bekijken

Here’s when and how to use Claude (or other AI tools) when applying to and interviewing with Anthropic. Where it makes sense, we invite you to use Claude to show us more of you: your unique perspective, skills, and experiences.

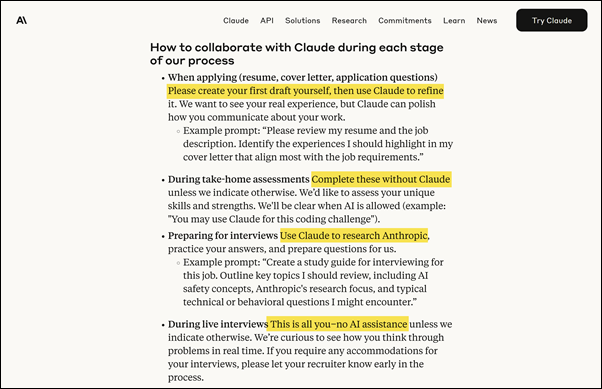

En daarna gaat Anthropic iets dieper in op de verschillende onderdelen van het sollicitatieproces en het al dan niet gebruiken van AI-ondersteuning tijdens de verschillende onderdelen daarvan:

AI guidance – Anthropic

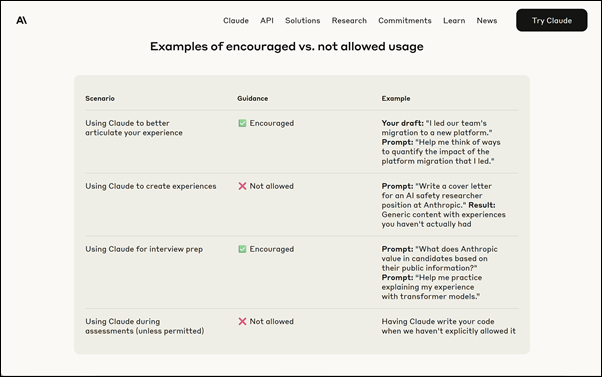

En dan hebben we ook nog deze voorbeelden:

AI guidance, 2 – Anthropic

En als laatste nog wat paternalistische opmerkingen, waarbij Anthropic enige wederkerigheid benoemt, zonder overigens volledig tranparant te zijn:

Ik vind het wel komisch dat van de sollicitant wordt verwacht om transparant te zijn over het gebruik van AI (pardon: Claude) terwijl Anthropic dit bepaald niet is:

We use Claude to create job descriptions, develop interview questions, draft and refine candidate communications, analyze hiring metrics, transcribe interviews, and identify candidates to source. We don’t use your data to train Claude or let Claude make hiring decisions.

Ik mis als activiteit ten het screenen van candidaten. Betekent het dat Anthropic dit handmatig doet? Zeer onwaarschijnlijk. En wat is identify candidates to source? Is Claude ook als people scraper in te zetten?

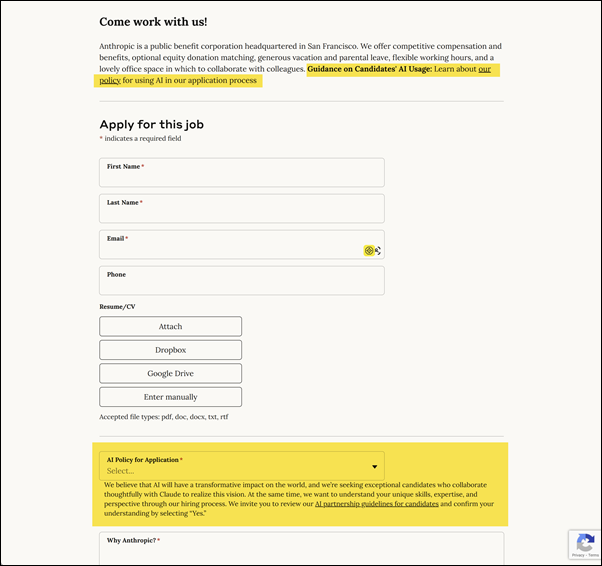

O ja, dit is een deel van het sollicitatieformulier van Anthropic. Waarbij sollicitanten moeten aangeven of ze de AI guidance hebben gelezen of niet:

Sollicitatieformulier – Anthropic

Met andere woorden, er is helemaal niets veranderd, het is alleen wat fluffy verwoord. Voor de buhne…