Voor wie het nog niet wist; Eightfold is een people aggregator. En dat is ze al een tijdje. Recent heeft Eighfold ook nog eens een class-action lawsuit aan haar broek gekregen. En daarmee is het een goede zaak voor (Europese) werkgevers om een eventuele keuze voor Eightfold zeer grondig tegen het licht te houden. Tenzij werkgevers zich weinig tot niets aantrekken van AVG/GDPR en AI Act (hoog risico).

Voor wie het nog niet wist; Eightfold is een people aggregator. En dat is ze al een tijdje. Recent heeft Eighfold ook nog eens een class-action lawsuit aan haar broek gekregen. En daarmee is het een goede zaak voor (Europese) werkgevers om een eventuele keuze voor Eightfold zeer grondig tegen het licht te houden. Tenzij werkgevers zich weinig tot niets aantrekken van AVG/GDPR en AI Act (hoog risico).

Ondanks deze achtergrond kwam Eightfold gisteren met wat ik als een krampachtige poging tot Eightfold whitewashing beschouw:

As the EU AI Act comes into force, one question is showing up in almost every conversation I have with HR and procurement leaders across Europe: “How do we know your AI doesn’t discriminate?” It’s the right question. And most vendors can’t answer it with data. Eightfold just published the full results of our 2026 independent bias audit — conducted by BABL AI Inc., covering more than 29 million candidate assessments across gender and race/ethnicity. Not a summary. Not a press release. Every number, every group, every finding. We passed. And we published it all.

Vol zelfvertrouwen, dat is een ding wat zeker is. Vervolgens legt Eightfold uit waarom Europa haar diensten moet gebruiken:

EU AI Act — Automated hiring tools are classified as high-risk AI. Transparency and third-party auditing are not optional — they are becoming a legal requirement. This is what compliance evidence actually looks like.

GDPR / DSGVO — The Eightfold model does not use demographic data as a scoring input. Outcomes were assessed after the fact. That matters for every DPA conversation you are having with legal and IT security.

Met als dramatische slotzin:

European customers deserve AI they can verify. Here is ours.

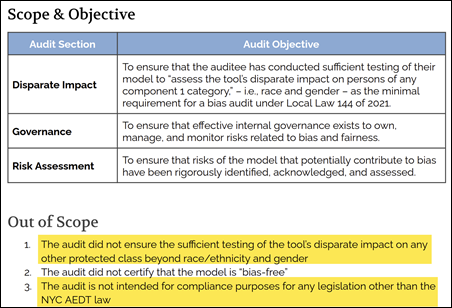

Ik heb een traantje van ontroering weg moeten pinken. Maar er is werk aan de winkel, dus heb ik het rapport eens nader bekeken, te beginnen met dit pareltje:

Summary of bias audit results – Eightfold

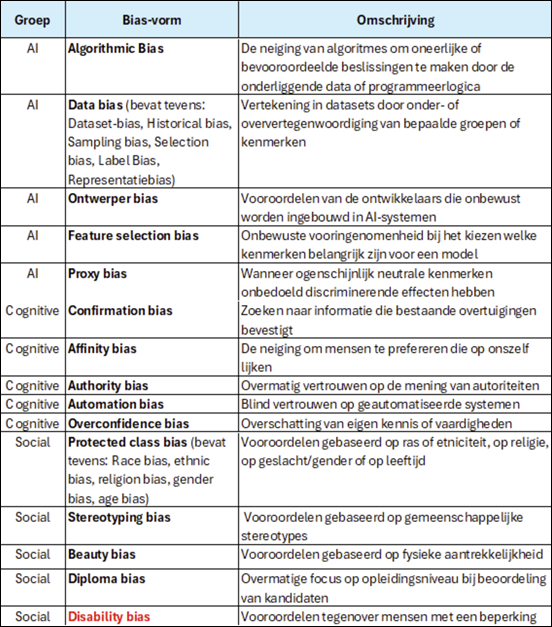

Ras en geslacht. Twee potentiële bias-vormen… Ter vergelijking; dit is een wat completer (maar zeker niet volledig) rijtje aan bias-vormen, waaronder een niet onaanzienlijk aantal AI-gerelateerde bias-vormen:

Veel voorkomene bias-vormen met een grote impact

De scope is dus microscopisch klein en daarmee volledig blind voor de vele, vele andere bias-vormen. Naast de minimale scope is er getoetst tegen van een lokale (New York City Local Law 144 ) wet. Ik weet niet precies waarom European customers dit verdienen…

En dan is er nog dit:

Terwijl de analyse is uitgevoerd op ongeveer 10 tot 13 miljoen kandidaten met bekende gegevens , zijn er maar liefst 75 miljoen kandidaten met een onbekend geslacht en 85 miljoen met een onbekende etniciteit. Als de groep “onbekend” vele malen groter is dan de groep die wel geanalyseerd is, is de kans op selection bias enorm. Het is aannemelijk te veronderstellen dat kandidaten die hun demografische gegevens niet delen, systematisch verschillen van degenen die dat wel doen.

En laten we vooral niet vergeten waar de kandidaatgegevens uit de Eightfold database vandaan komen…