Je loopbaan eindigt hier. Door één klik

Intrigerende titel, toch? Ik moet eerlijk bekennen dat er wel een beetje hyperbool in zit. Maar het is echt maar een klein beetje want je kan ongemerkt je eigen glazen (lees: carriere) ingooien als je besluit om online te solliciteren via een grotere vacaturesite (lees: Indeed, Stepstone, Nationale Vacaturbank) of LinkedIn. Deze sites verzamelen namelijk gegevens over het (gebrek aan) succes van jouw online sollicitaties bij werkgevers of intermediairs (uitzendbureau’s of recruitment bureau’s). En met die gegevens beïnvloeden ze (onder meer) welke vacatures je te zien gaat krijgen. Zonder dollen.

Intrigerende titel, toch? Ik moet eerlijk bekennen dat er wel een beetje hyperbool in zit. Maar het is echt maar een klein beetje want je kan ongemerkt je eigen glazen (lees: carriere) ingooien als je besluit om online te solliciteren via een grotere vacaturesite (lees: Indeed, Stepstone, Nationale Vacaturbank) of LinkedIn. Deze sites verzamelen namelijk gegevens over het (gebrek aan) succes van jouw online sollicitaties bij werkgevers of intermediairs (uitzendbureau’s of recruitment bureau’s). En met die gegevens beïnvloeden ze (onder meer) welke vacatures je te zien gaat krijgen. Zonder dollen.

ABU: 47 achtereenvolgende perioden met krimp…

Ik heb me een tijdje onvoldoende gekweten van mijn taak als chroniqueur (oid) van de uitzendbranche. Waar ik tot en met periode 12 van vorig jaar al jarenlang puntueel verslag doe van de ups en downs van de grote uitzenders is het een aantal maanden opvallend stil gebleven. Ik was otherwise engaged. Maar dat is natuurlijk geen excuus. Daarom vanaf deze plaats een welgemeende verontschuldiging en een toezegging dat ik mijn leven zal proberen te beteren. Inderdaad, zonder garanties, want ik ben ook maar een mens. Anyhow, na ABU periode 12, 2025: droef het jaar uit heb ik twee ABU periodes voorbij laten gaan. En dat ga ik nu inhalen:

Ik heb me een tijdje onvoldoende gekweten van mijn taak als chroniqueur (oid) van de uitzendbranche. Waar ik tot en met periode 12 van vorig jaar al jarenlang puntueel verslag doe van de ups en downs van de grote uitzenders is het een aantal maanden opvallend stil gebleven. Ik was otherwise engaged. Maar dat is natuurlijk geen excuus. Daarom vanaf deze plaats een welgemeende verontschuldiging en een toezegging dat ik mijn leven zal proberen te beteren. Inderdaad, zonder garanties, want ik ben ook maar een mens. Anyhow, na ABU periode 12, 2025: droef het jaar uit heb ik twee ABU periodes voorbij laten gaan. En dat ga ik nu inhalen:

In periode 13 [2025] daalde het aantal uren met 3% en de omzet nam toe met 3%, in vergelijking met dezelfde periode vorig jaar.

In periode 1 [2026] daalde het aantal uren met 6% en de omzet nam toe met 1%, in vergelijking met dezelfde periode vorig jaar.

Nou, voor dit soort resultaten kom je liever niet je bed uit, maar daarvoor is het nu te laat. Krimp, krimp en niets dan krimp, ook al was dat in periode 13 de laagste krimp sinds periode 5 van 2025. Maar het is nog altijd een krimp, en daar word je als uitzendliefhebber toch behoorlijk chagrijnig van.

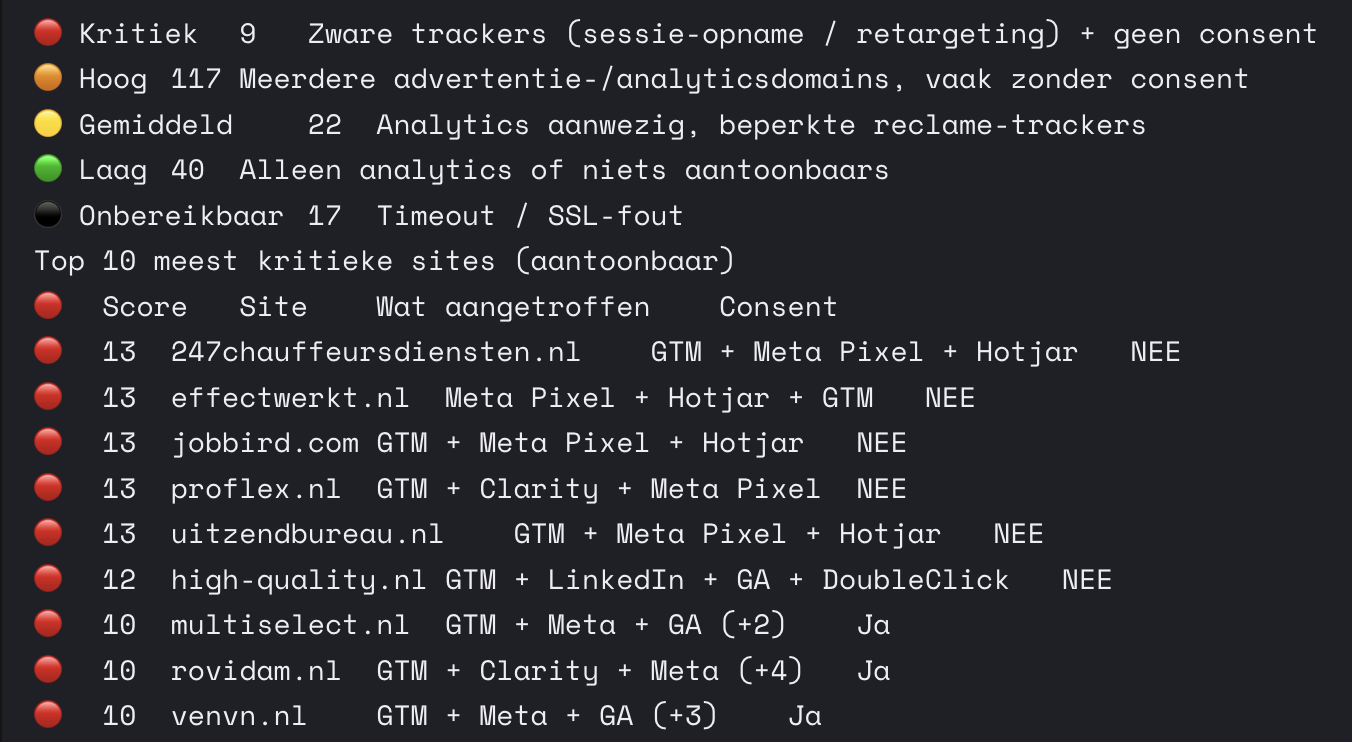

ANYTHING.AI: zo scary zijn Nederlandse vacaturesites (AP lezen jullie mee?)

(scroll door voor de download)

Dat we allemaal werkloos worden, dat geloof ik niet. Maar dat sommige rotklusjes overgenomen gaan worden, dat zal ik hieronder overtuigend demonstreren.

Dit doe ik aan de hand van vacaturesites. Ik wil weten of ze mijn muis filmen. Vroeger moest ik hiervoor een programma schrijven – dat alle vacaturesites bezoekt en bekijkt wat er precies gebeurt – voordat ik kon weten van de hoed en de rand. Zo’n programma kost een uur, of een dag, of een week. In ieder geval méér dan één minuut.

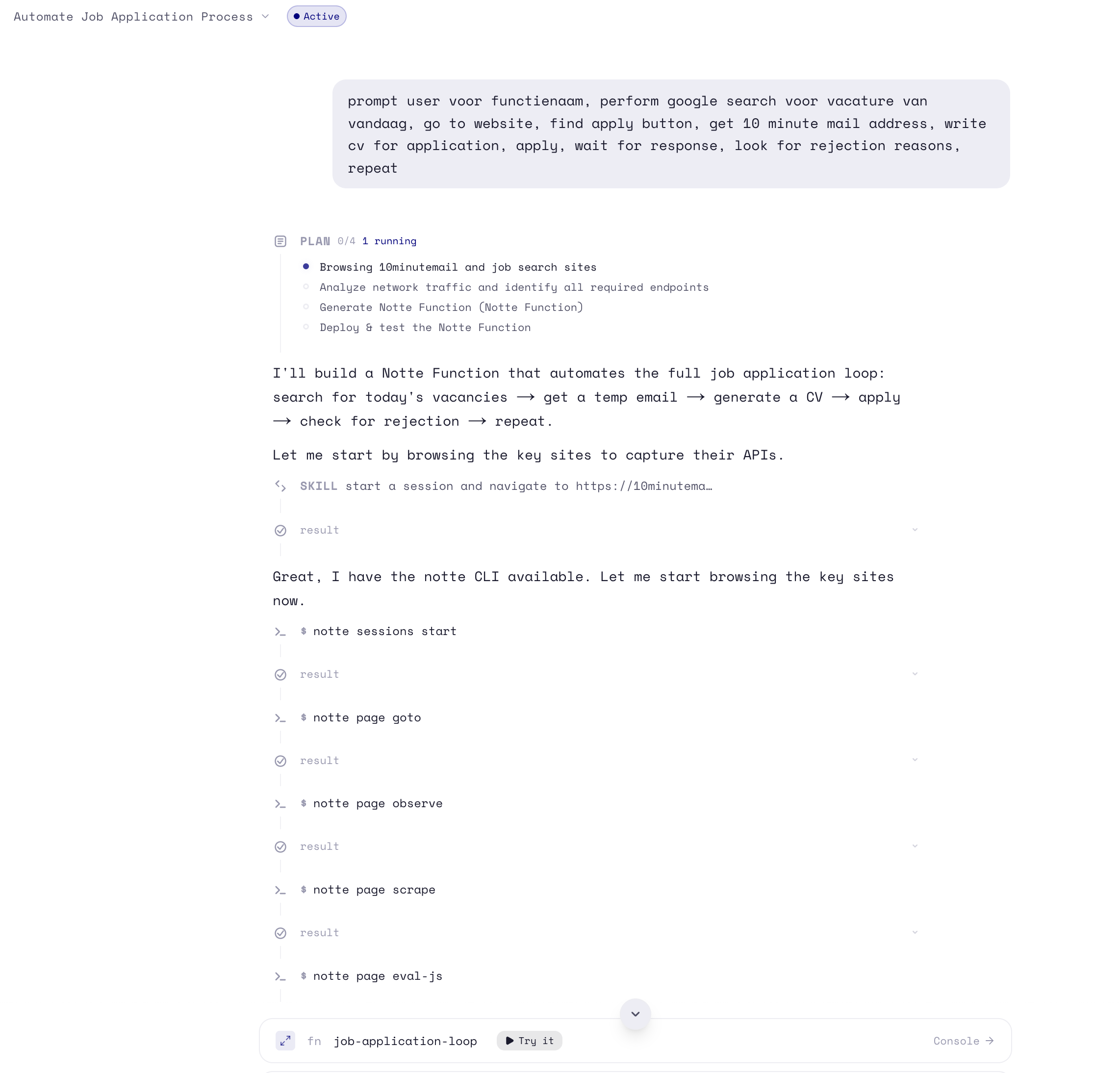

Met anything.ai was ik minder dan een minuut kwijt. Ik heb geen persoonsgegevens af hoeven staan en heb nergens voor hoeven betalen. Ik vind het resultaat eerlijk gezegd verbluffend. Dit is wat ik deed:

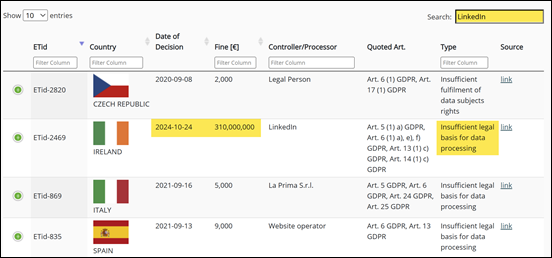

(meer…)LinkedIn heeft één (1) serieuze (niet-geïnde) boete binnen de EU

LinkedIn is binnen het recruitment domein niet alleen een heel grote vis, en een zo mogelijk nog grotere data grabber:

In 2016 lanceerde LinkedIn Recruiter System Connect (RSC) en dat is het startmoment van LinkedIn’s data grab. Inderdaad, deze praktijk is al tien jaar aan de gang! De hoeveelheid informatie die LinkedIn ondertussen moet hebben verzameld is vrijwel onvoorstelbaar.

Opvallend genoeg is er vanuit de EU slechts oorverdovende stilte te horen, met niet meer dan één (niet-geïnde) boete mbt LinkedIn:

Overtedingen LinkedIn – GDPR Enforcement Tracker

Mijn salaris eis? €500.000,– per minuut

Gisteren heb ik in één minuut een blog geschreven, terwijl ik een hr applicatie ontwikkelde met ai.

Het ai’tje dat ik aan het werk zette is uitgeraasd.

Vandaag de evaluatie. Ook in één minuut.

Waar waren we?

Oh ja, ik moest een prompt intikken in ANYTHING en daarna ook nog op enter drukken.

Emiel begon meteen te ratelen en ai dingetjes uit te spugen.

Voor het eerst sinds lange tijd had ik weer het speciale gevoel: wow! dit is revolutionair!

Heerlijk.

(meer…)Een korte mededeling van algemeen belang

Zoals het er nu naar uitziet, zijn intermediairs en werkgevers de originele bronnen bij het rondswaffelen van persoonsgegevens van sollicitanten. ATS’en en CRM’s faciliteren dit geswaffel en partijen als LinkedIn/Glassdoor en Indeed (en kleinere vacaturesites zoals Stepstone, Totaljobs, Seek, Nationale Vacaturebank en mogelijk vele, vele anderen) slobberen al die persoonsgegevens op waarmee de illusie volledig aan flarden wordt geschoten dat de werkzoeker in control is bij het zoeken naar een nieuwe baan. O ja, tegelijkertijd overteden intermediairs, werkgevers, ATS’en, CRM’s, LinkedIn/Glassdoor, Indeed, en kleinere vacaturesites (zoals Stepstone, Totaljobs, Seek, Nationale Vacaturebank en mogelijk vele, vele anderen) binnen de EU de AVG/GDPR op een industiële schaal. En als de AI-Act (hoog-risico) ooit nog wordt ingevoerd, wordt ook die wet per direct overtreden.

Zoals het er nu naar uitziet, zijn intermediairs en werkgevers de originele bronnen bij het rondswaffelen van persoonsgegevens van sollicitanten. ATS’en en CRM’s faciliteren dit geswaffel en partijen als LinkedIn/Glassdoor en Indeed (en kleinere vacaturesites zoals Stepstone, Totaljobs, Seek, Nationale Vacaturebank en mogelijk vele, vele anderen) slobberen al die persoonsgegevens op waarmee de illusie volledig aan flarden wordt geschoten dat de werkzoeker in control is bij het zoeken naar een nieuwe baan. O ja, tegelijkertijd overteden intermediairs, werkgevers, ATS’en, CRM’s, LinkedIn/Glassdoor, Indeed, en kleinere vacaturesites (zoals Stepstone, Totaljobs, Seek, Nationale Vacaturebank en mogelijk vele, vele anderen) binnen de EU de AVG/GDPR op een industiële schaal. En als de AI-Act (hoog-risico) ooit nog wordt ingevoerd, wordt ook die wet per direct overtreden.

Laat ik deze puinhoop maar eens omschrijven via het fijnbesnaard parafraseren van LinkedIn’s motto: Always fuck our members first…

Indeed’s mission is to enshittify people get jobs

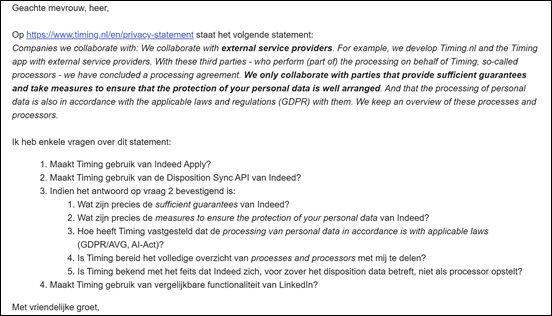

Ik heb een reactie van Indeed! Tenminste, van het pr-bureau van Indeed. Begin van het jaar heb ik de privacy afdeling van Indeed een aantal vragen gesteld maar daar geen antwoord op gekregen. Vervolgens heb ik op 19 januari een (iets grotere) vragenlijst gestuurd naar de Managing Director Benelux at Indeed & Glassdoor, met daarbij de begeleidende tekst:

Ik heb een reactie van Indeed! Tenminste, van het pr-bureau van Indeed. Begin van het jaar heb ik de privacy afdeling van Indeed een aantal vragen gesteld maar daar geen antwoord op gekregen. Vervolgens heb ik op 19 januari een (iets grotere) vragenlijst gestuurd naar de Managing Director Benelux at Indeed & Glassdoor, met daarbij de begeleidende tekst:

Aangezien Indeed doof schijnt te zijn voor mijn verzoeken om informatie mbt disposition data stuur ik je hierbij mijn vragen. Deze zijn in ieder geval relevant binnen het EU domein (AVG/GDPR en AI Act). Ik ga er vanuit dat Indeed deze vragen moet kunnen beantwoorden, als er vragen zijn dan geef ik graag een toelichting.

Dat leidde op 28 januari tot de volgende reactie, van wat blijkbaar het pr-bureau van Indeed is:

Als pr-bureau van Indeed kreeg ik de vragen die je per mail en privé aan Stan gesteld hebt doorgestuurd. Ik kan je nu (nog) geen antwoord geven, maar weet dat we de vragen in goede orde hebben ontvangen en dat we bij je terugkomen als we je meer kunnen vertellen.